Global X legte im September 2016 die ersten ETFs auf künstliche Intelligenz auf. Seitdem erzielten sie eine annualisierte Rendite von 9,3 %. Zum Vergleich: Der Nasdaq 100 brachte 15,4 %. Angesichts des Hypes um den Sektor ist das ein bescheidenes Ergebnis.

Grafik 1: Nasdaq 100 vs. KI

Quelle: Financial Times/Markets data. Die orange Linie zeigt den Nasdaq, die blaue Linie den Global X.

Wir investieren also in KI. Doch vielleicht haben wir noch nicht ganz begriffen, dass wir zunehmend mit KI investieren (und leben). Daher stellt sich für ETF-Anleger die Frage: Wie, wie viel und ob überhaupt KI in der eigenen Arbeit einsetzen? Vor allem aber: Wie steht es um das Verhältnis von Risiko und Chance? Was wir über KI wissen, ist nur ein kleiner Ausschnitt des noch unerforschten Gebiets.

Eine pauschale Antwort ist unmöglich. Es kommt stark auf den Einsatzbereich an. Begeisterung ist angebracht, wenn KI langweilige, repetitive oder zeitaufwendige Aufgaben mit geringem Mehrwert übernimmt. Denken Sie an die Copilot-Plattform zur Erstellung von PowerPoint-Präsentationen. Was früher Stunden dauerte und typografisches Geschick erforderte, gelingt nun in wenigen Minuten.

Ebenso erfolgreich ist der Einsatz bei der Informationsauswahl zur Unterstützung von Analyse und Auswahl. Selbst KI-Veteran ChatGPT ist nützlich, um gezielt ETFs mit den gewünschten Merkmalen zu finden. Schwierig wird es, wenn die Aufgaben intellektuell anspruchsvoller werden. Beim Schreiben von Programmcode (VBA Office, Python) können gravierende Fehler auftreten.

So vergaß ChatGPT einmal, die Korrelationsmatrix zwischen Anlageklassen bei der Portfoliooptimierung zu berücksichtigen. Als Assistent ist die KI jedoch sehr gehorsam. Sie weist Fehlerberichte nicht zurück. Bei solchen Fällen entschuldigt sie sich und wiederholt die Aufgabe, bis das erwartete Ergebnis erreicht ist. Selbst bei theoretischen Fragen unterläuft ihr gelegentlich ein schwerwiegender Fehler.

Der Physiker und Nobelpreisträger Carlo Rubbia (1984) sagte einst: „Der PC ist ein schneller Idiot.“ KI sei eine schnelle Intelligenz, da sie aus Fehlern lerne.

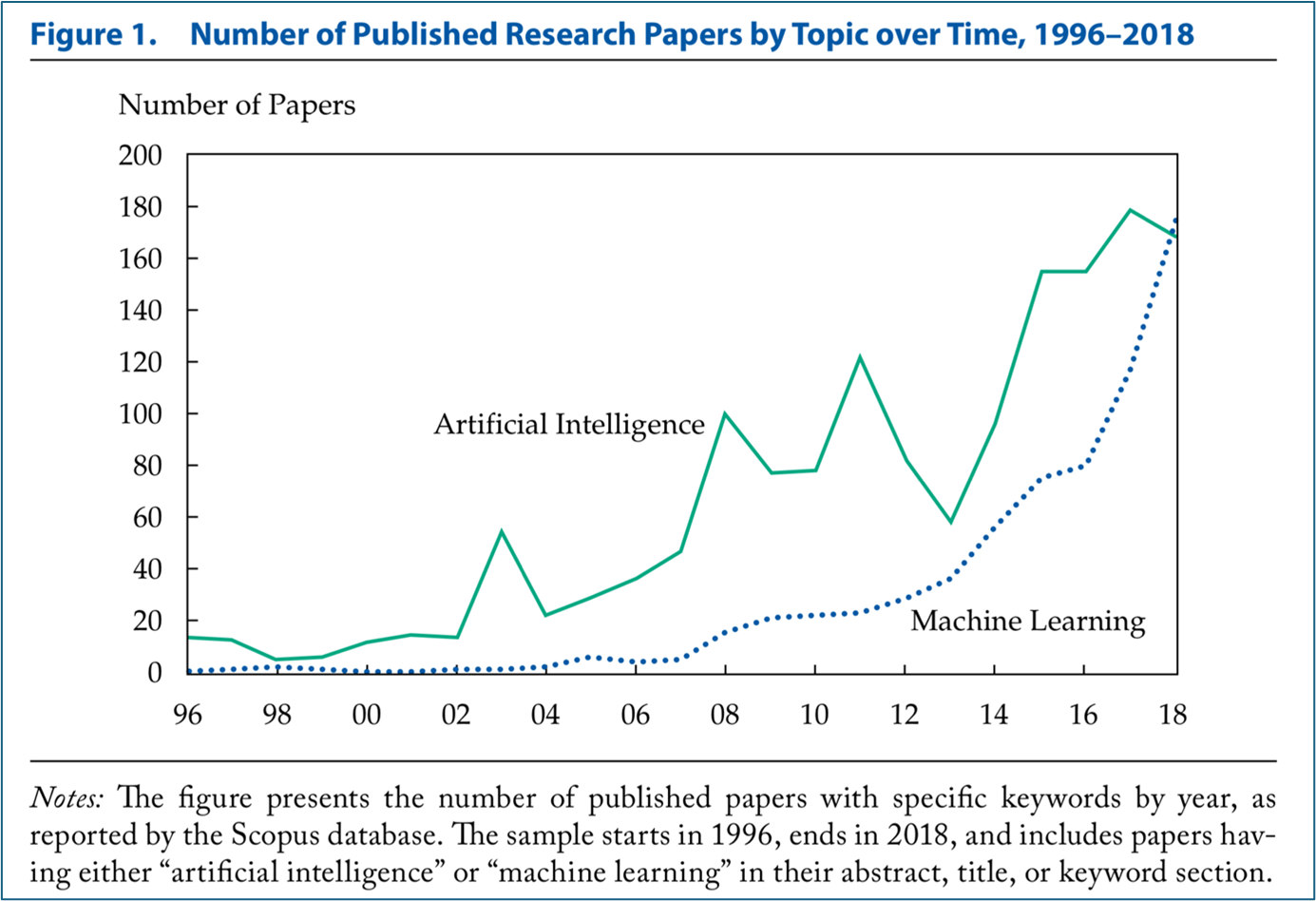

Quelle: Vv, Aa, Artificial Intelligence in Asset Management, CFA Institute Research Foundation/Literature Review

All dies ist jedoch noch Zukunftsmusik. Die Konstruktion von Asset Allocation und die Schätzung von Renditen, Volatilitäten und erwarteten Korrelationen gehören zu den vornehmsten Anwendungen. KI verarbeitet Daten in einem Umfang, der noch vor Kurzem undenkbar war. Im Trading generiert sie operative Signale in nie dagewesenem Ausmaß. Sie vereinfacht die Analyse von Fundamentaldaten von Unternehmen für Long- und Short-Positionen. Sie katalysierte die Entwicklung von Robo-Advisors, deren Nutzung durch das ETF-Wachstum erleichtert wird. Im Gegensatz zum Menschen wird der Entscheidungsprozess einer KI jedoch nicht von Biases und Rauschen beeinflusst – ganz im Gegenteil.

Die wirklichen Zweifel und Bedenken gelten Einschränkungen heutiger KI, die zu unbeabsichtigten, schwerwiegenden oder irreparablen Folgen führen könnten.

Nutzer von KI sollten die potenziellen – meist versteckten – Risiken dieses neuen Werkzeugs verstehen. Diese Risiken hängen mit der Komplexität und Intransparenz der Funktionsweise zusammen. Wie reagieren KI-Algorithmen auf ein „Schwarzes Schwan“-Ereignis? Könnten sie einen kaskadierenden Marktabsturz auslösen, selbst ohne größere negative Ereignisse? KI-Algorithmen können durch minderwertige Daten fehlgeleitet werden und falsche Schlussfolgerungen ziehen. Ihre Schwäche ist, dass sie stets eine Antwort liefern, auch wenn es keine gibt. Wie viel Kontrolle hätte ein Mensch in einem solchen Fall über den Algorithmus?

Zweifellos hat die KI-Revolution, nach ihrem langen Winterschlaf, gerade erst begonnen. Obwohl der Begriff seit 1955 existiert, als John McCarthy ein Workshop zur künstlichen Intelligenz veranstaltete, hat sie noch einen langen Weg vor sich. Die Hauptrisiken liegen daher in den erwähnten unbeabsichtigten Folgen.

Die brandneue Boeing 737 MAX Lion Air JT610 auf dem Flug von Jakarta am 29. Oktober 2018 mit 189 Menschen an Bord ist ein Beispiel. Wenige Minuten nach dem Start meldeten die Piloten technische Probleme mit dem Flugsteuerungssystem. Das Flugzeug stürzte kurz darauf in die Javasee. Ursache? Schon in der Design- und Testphase zeigte die Maschine eine zu starke Tendenz, bei maximaler Leistung die Nase zu heben, verglichen mit älteren Modellen. Boeing hätte die Aerodynamik überarbeiten müssen. Stattdessen entschied man sich für eine Softwarelösung: weniger aufwendig, günstiger und schneller. So entstand der MCAS-Algorithmus. Er sollte das Verhalten der 737 MAX eigenständig korrigieren, ohne Eingreifen des Piloten. Das sparte auch Zeit und Geld, da Pilotenschulungen entfielen.

Einige fehlerhafte Codezeilen verursachten also Unfälle mit Hunderten von Toten, die traditionelle Konstruktionstechniken fast sicher verhindert hätten. Könnten Finanzalgorithmen, wenn sie sich verbreiten, einen Marktabsturz auslösen, wie wir ihn noch nie erlebt haben?

Wie der Dramatiker Fjodor Dostojewski sagte: „Klugheit allein reicht nicht aus, um Kluges zu tun.“ Diese Warnung gilt nicht nur für KI, sondern auch für jene, die sie achtlos einsetzen.

Edoardo Mezza ist Direktor, Filippo Arena ist Privatkundenberater bei der Banca Patrimoni Sella & C.